機械学習の手法のうち「ロジスティック回帰」について。

目次

AI・ディープラーニングの全体像

- 人工知能

- 機械学習

- ディープラーニングの基本・応用

- ディープラーニングの研究

- AIプロジェクト

- AI社会実装に伴う法律・倫理

機械学習(教師あり学習)の手法②ロジスティック回帰

概要

- 「ロジスティック回帰分析(Logistic Regression)」→線形分析の考え方を用いて、ある事象が起こる確率を求める手法

- 確率値は「0~1」の範囲に収まる必要があり、ロジスティック回帰分析に用いられる関数の仕様上、モデルの出力値は必ず「0~1」の範囲に収まり、適している

”非線形回帰の手法”としてのロジスティック回帰分析

- 「線形回帰」→説明変数と目的変数との間に線形な関係を仮定している分析モデル(単回帰分析、重回帰分析)

→目的変数と説明変数とが「線形結合」として表され、グラフは「直線」となる(目的変数が変化する割合が常に一定) - 「非線形回帰」→非線形関数を用いて、説明変数と目的変数との間の関係性を表現するもの

→線形関数(直線関数)ではなく、対数関数や平方根などの非線形関数(非直線関数)を用いる

(ロジスティック回帰は、非線形回帰の手法のひとつ)

ロジスティック回帰分析

- 「ある事象が発生する確率」を求める非線形回帰の手法

- 線形回帰と同様の考え方をクラス分類問題に応用する手法

- ロジスティック回帰分析は、回帰問題を扱うのではなく、分類問題を扱うもの

- 「二値分類(カテゴリが2つ)」と、「マルチクラス分類(カテゴリが3つ以上)」の両方に適用

※二値分類の例:腫瘍細胞の形状等の特徴から、腫瘍が良性か悪性かを予測など

※マルチクラス分類の例:身長と体重から、服のサイズ(S・M・L)を予測など

二値分類

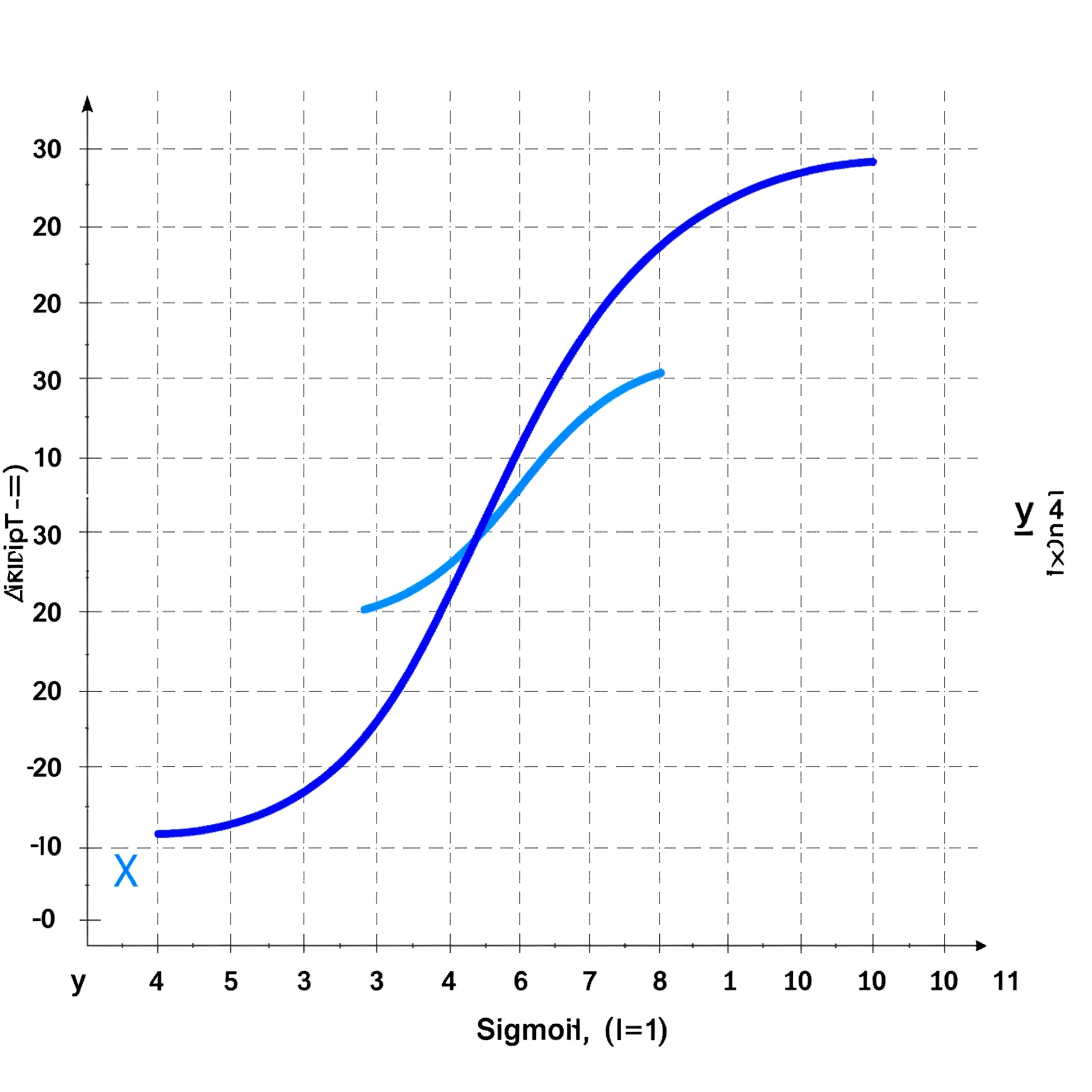

- 「シグモイド関数」を用いる

- f(x) = 1 / (1 + e(-x))

- シグモイド関数の「値域」は、0~1

- どのような値が入力されても、出力される値は0~1に収まるよう正規化される(=ある事象が起きる確率)

- シグモイド関数→非線形の関数→ロジスティック回帰は非線形の手法

- ロジスティック回帰における「確率」の予測

→シグモイド関数(出力値が”0.5以上であればA”、”0.5未満であればB”など、0~1の範囲に変換)を通すことで、確率として表現することができる

→よって、ロジスティック回帰とは非線形回帰であるといえる - シグモイド関数は、線形回帰では扱うことができない複雑なデータにも対応することができる

マルチクラス分類

- 「ソフトマックス関数」を用いる

- 各クラスの出力値が0~1の間にあり、全クラスの出力の合計が1となるよう正規化される