機械学習について。

目次

AI・ディープラーニングの全体像

- 人工知能

- 機械学習

- ディープラーニングの基本・応用

- ディープラーニングの研究

- AIプロジェクト

- AI社会実装に伴う法律・倫理

ノーフリーランチ定理

- 「ノーフリーランチ定理(No Free Lunch Theorem)」

→あらゆる問題において高い精度が出せる汎用的なモデルは存在しない

(万能な機械学習モデルはない) - どのモデルを使用するか→分析の目的、データの種類、必要なデータ処理、分析コストなどの要素を踏まえ、ケースバイケースで判断

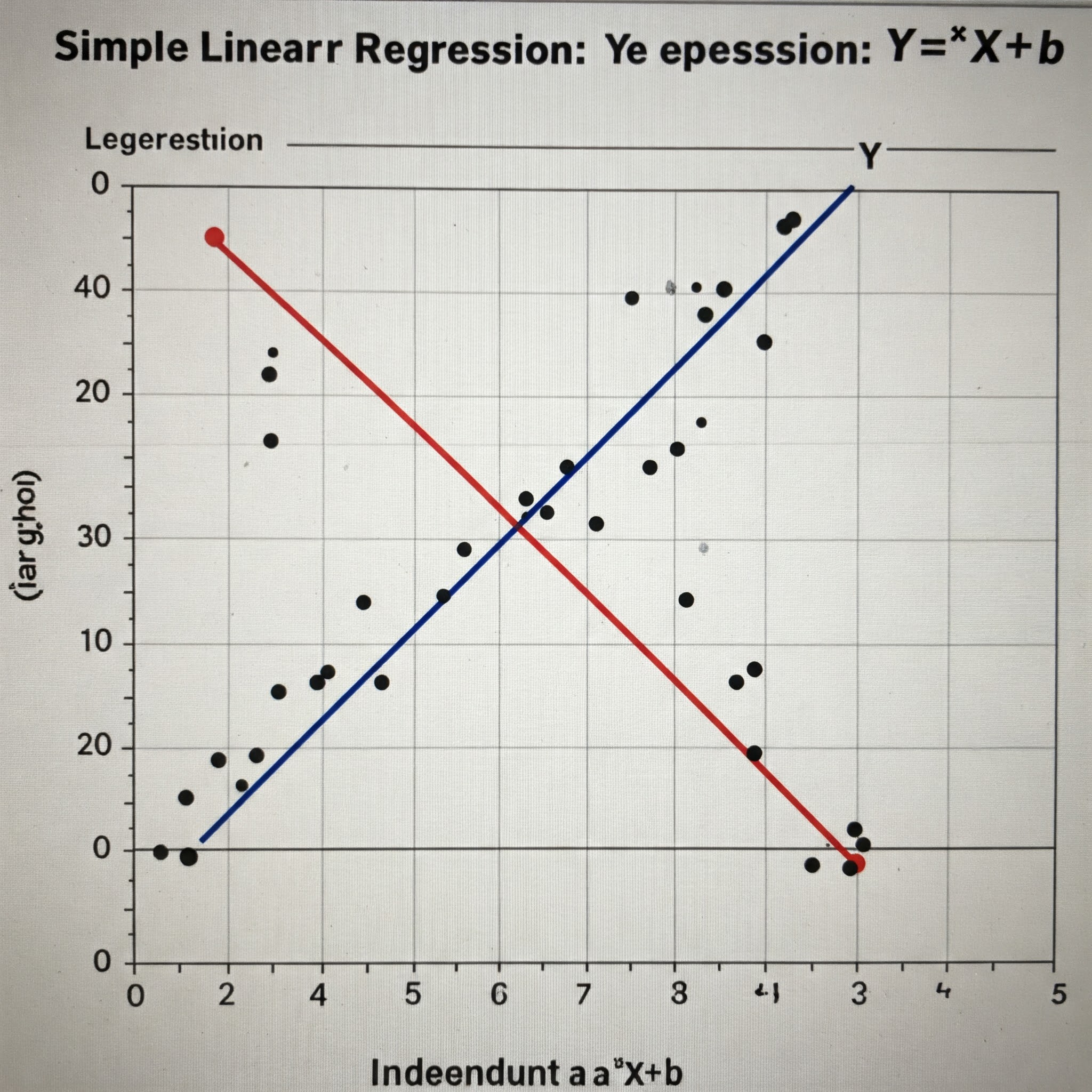

過学習とは

- 「過学習(Over-Fitting)」=オーバーフィッティング、過剰適合

→学習モデルを過剰に学習すること=モデルを学習データに合わせすぎてしまって、未知のデータに対する汎用性能を失わせてしまっている状況 - 学習済みモデルについての望ましい状況:未知な新しいデータに対し、答えとしての予測精度が出せること

- 学習済みモデルについての避けたい状況:訓練データにのみ予測精度がよく、未知データに対しての予測の誤差が大きいこと

- 一般的に、モデルが複雑であればあるほど過学習しやすい

過学習の確認

- モデルのパラメータを変更した際、テストデータに対する精度が横ばいまたは低下している

- 「バイアス(偏り)」→推定値と実績値の差(ずれ)

- 「バリアンス(分散)」→推定のばらつき

- バイアスとバリアンスは、トレードオフ

- 過学習になりやすいのは、「バイアスが低く、バリアンスが高い状態」

過学習の主な原因

- データ数が少ないにもかかわらず、「特徴量(説明変数)」の数が多すぎる

- 「相関」が強い特徴量が多く存在する

- モデルが複雑すぎる(高次元の関数など)

- モデルの「パラメータ」の値が大きすぎる(線形回帰の係数など)

過学習への対策

- 学習データの数を増やす(→傾向が掴みやすくなり、より汎用的なパターンを捉えやすくなる)

- ハイパーパラメータを調整し、モデルの複雑さを抑える(モデルの複雑さや学習進行を設定するパラメータで、人が手動で調整する)

- 「正則化」を実施する(モデルの動きに制限を課し、複雑になりすぎるのを防止)